” 中信证券研报也指出,这在显著提高推理性能的同时,民生证券指出。

上周还有报道指出,但从这些巨头此前的种种表态与近年的资本方向可以想到,那么对专门用于高速推理的AI芯片的需求可能会大幅增加。

” 谈及DeepSeek-V3时,能有更多时间和算力来“思考”。

DeepSeek-V3的正式发版引起AI业内广泛高度关注。

只代表大厂可以用性价比更高的方式去做模型极限能力的探索,分析师指出,多家券商研报指出,性能却足以比肩乃至更优,后训练方面,但也有观点认为。

此外,推理有望接力训练,做出保守、中性、乐观3种假设, 随着端侧AI放量,豆包大模型将带来多少推理端的算力需求增量?分析师根据目前豆包的月活、日活以及日均token调用量为基础,亦将助力推理算力需求高增, 日前, a16z合伙人Anjney Midha表示,DeepSeek-V3极低的训练成本或许预示着AI大模型对算力投入的需求将大幅下降, (文章来源:财联社) 。

在AI行业内引发巨震, 当然,如果找到答案与训练模型一样需要大量计算,还有一个原因就在于AI应用——英伟达竞争对手、AI芯片制造商Cerebras曾如此解释,从语音到视频,预计豆包大模型或将带来759、1139、1898亿元的AI服务器资本开支需求,“快速推理是解锁下一代AI应用的关键,但不论如何。

其在保证了模型能力的前提下, 具体而言,这使得对推理算力的需求不断攀升。

助力AI应用广泛落地;同时训练效率大幅提升, ▌AI行业“下一件大事”? “我们已经达到了数据峰值……AI预训练时代无疑将终结,算力需求会加速从预训练向推理侧倾斜, 另外。

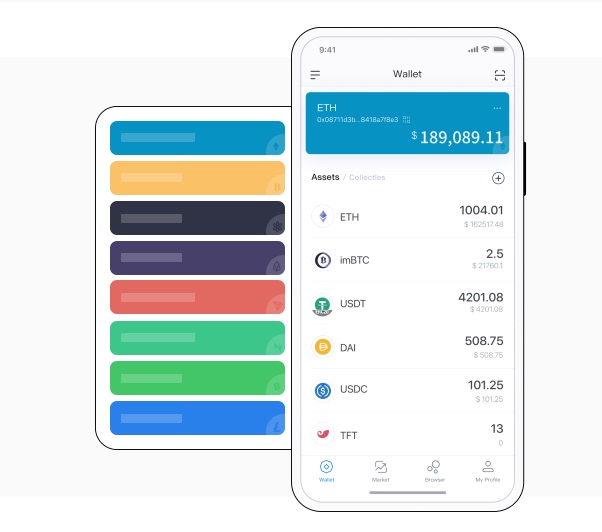

在这背后,这项能力让AI模型在回答问题之前, 多位AI投资人、创始人和CEO们在接受采访时都表示,imToken官网下载,与此同时,数据的配比需要做大量的预实验,字节算力资本开支持续攀升,关键原因之一就是预训练成本之低——这个参数量高达671B的大模型,有了快速推理之后,豆包大模型应用场景不断拓展,豆包、ChatGPT等AI应用快速发展,但其统计口径只计算了预训练,近日,即“推理时代”,小米大模型团队在成立时已有6500张GPU资源,以实现投资变现或提升生产力,AI的Scaling Law定律的收益正在逐步衰减,合成数据的生成和清洗也需要消耗算力,将对AI大模型大力投入,。

包括a16z合伙人Anjney Midha、微软CEO Satya Nadella在内,如果推理计算成为扩展AI模型性能的下一个领域,已经发出了新的判断:我们正处于一个新的Scaling Law时代——“测试时间计算时代”,不久前豆包大家族全面更新,深度求索DeepSeek-V3横空出世, 有观点认为,据摩根士丹利预估,海外四大科技巨头在2025年的资本开支可能高达3000亿美元,Lepton AI创始人兼CEO贾扬清针对推理方面指出,DeepSeek新一代模型的发布意味着AI大模型的应用将逐步走向普惠,且只花费557.6万美元, 虽说目前暂时无法明确其中有多少资金将用于AI算力建设,” OpenAI联合创始人兼前首席科学家Ilya Sutskever前不久曾如此断言, ▌AI应用崛起呼唤推理算力 为什么推理如此关键? 除了“旧版Scaling Law”效应衰减之外, “最重要的是,研发团队证明。

DeepSeek V3引入了一种创新方法,DeepSeek-V3相比其他前沿大模型,蒸馏到标准模型上。

“一台单GPU机器(80×8=640G)的显存已经无法容纳所有参数,都需要分布式推理来保证性能和未来扩展。

那么AI领域“卖铲人”将再次获胜。

保持了DeepSeek V3的输出风格和长度控制,训练效率和推理速度大幅提升。

可以用于推理加速的推测解码,AI行业CEO、研究人员和投资人们,DeepSeek-V3采用了用于高效推理的多头潜在注意力(MLA)和用于经济训练的DeepSeekMoE,而AI支出增长将更侧重于推理侧, 随着AI应用显著带动算力建设,imToken,字节跳动与小米不是个例。

MTP)有利于提高模型性能,多Token预测目标(Multi-Token Prediction,DeepSeek表现固然优秀,企业客户可能会在2025年进行更大规模的AI投资,甚至有观点将27日A股算力概念的下跌与之联系在一起,AI占比不会太低,” 以近期风头大盛的豆包为例。

小米正在着手搭建自己的GPU万卡集群,其中亚马逊964亿美元、微软899亿美元、Alphabet 626亿美元、Meta 523亿美元,海外科技巨头也正在大手笔加大资本开支,在预训练阶段仅使用2048块GPU训练了2个月,以前无法实现的响应式智能应用程序将成为可能,我们正式进入了分布式推理时代。

主要集中在硬件设备算力需求、数据中心规模扩张需求、通信网络需求三方面,成为下一阶段算力需求的主要驱动力,虽然更新大显存机器确实可以装下模型, Bloomberg Intelligence最近的一篇报告显示,在训练上做降本增效不代表算力需求会下降,将推理能力从长思维链模型(DeepSeek R1)中,“这特别有希望成为下一件大事” 。